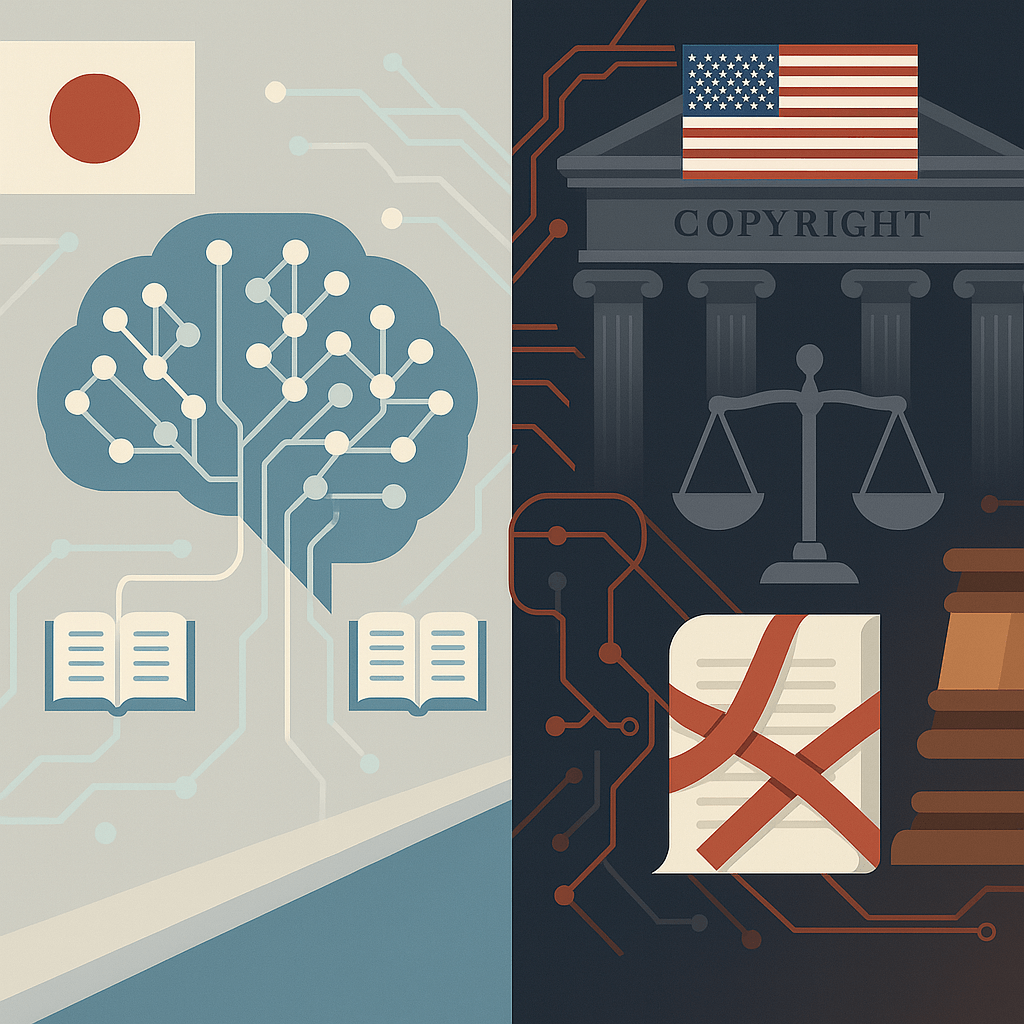

著作権で保護された書籍をAIのトレーニングに使うことってOKなの?

私は、大手テック企業が海賊版の素材を使ってAIを訓練していることに関する、米国での2つの訴訟をフォローしています。これらの訴訟は、この種のものとしては初めてであり、将来的に私たちがAI(別名:大規模言語モデルまたはLLM)をどのように訓練するかを決定する前例として確実に使用されるため、興味深いものです。

免責事項:LLMとAIに直接携わる者として、ここで私の考えを共有しています。私は弁護士ではなく、これは法的助言ではないことにご留意ください。

訴訟の背景

2つの訴訟は以下の通りです

- Kadrey対Meta Platforms, Inc.

- Bartz対Anthropic

書籍の著者たちは、テック企業が自分たちの著作権のある書籍を大規模言語モデル(LLM)の訓練に使用していると主張して、MetaとAnthropicを訴えています。訴訟手続きの中で、これらの企業が実際に著作権のある書籍の海賊版を使ってLLMを訓練していることが明らかになりました。彼らはそれを否定しようともしません!一方で、テック企業は「そうすることは問題ない」と主張して自己弁護しています。

私たち一般人にとっては、おそらくそれは信じられないことで、テック企業は何か間違ったことをしたと思うでしょう?少なくとも私はそう思いました。

しかし、今週の別々の判決で、裁判官はMetaとAnthropicに対する著作権侵害の申し立てを却下しました。ただし、両方の決定には重要な留保事項があり、それが実際に将来の成功する異議申し立てへの道筋を提供する可能性があります。

MetaとAnthropicの訴訟の違い

この分析に至るまでの私の視点は、主に2つの情報源から得られました:NPRのChloe Veltmanによる記事と、DiginomicaのChris Middletonによる特に洞察に富んだ要約です。

Metaの訴訟(Chhabria裁判官):

- 問題点: 著者たち(Sarah Silverman、Ta-Nehisi Coatesを含む)は、Metaが許可なく彼らの書籍でAIを訓練したことで訴えた

- 著者たちが証明できなかったこと: 具体的な経済的損害や、MetaのAIが彼らの作品と直接競合していることを示すことができなかった

- 裁判官の理由: 「あなたたちは、これがあなた個人や書籍の売上を傷つけたことを証明していない」

- 決定的証拠: 裁判官は、CEOのMark Zuckerbergが決定に関与した後、Metaがライセンス料を支払うよりも意図的に海賊版の書籍を選んだことを発見した

- 裁判官の警告: 市場への損害を証明することで、将来の訴訟が勝訴する可能性があることを強く示唆した

Anthropicの訴訟(Alsup裁判官):

- 問題点: 3人の著者が、Anthropicが彼らの著作権のある作品でClaude AIを訓練したことで訴えた

- 裁判官の理由: 「変換」に焦点を当てた - AIは書籍から学習して、学生がより良い作家になるために読書するように、完全に異なるものを作り出したと主張した

- 裁判官の警告: 裁判官は、著者たちがAIが直接的なコピーや模倣品を作っていることを証明できれば、これは「別の訴訟」になるだろうと述べた

Simon Willisonのllmツールを使って、上記のポイントに基づいて一般人が理解できるものをgemma3:12bに書いてもらいました:

Metaの訴訟は、盗んだ教科書を購入する代わりに使ってカンニングをしているのが見つかった学生のようなものでしたが、元の教科書の著者が自分の成績が下がったことを証明できなかったため、教師は彼らを罰することができませんでした。裁判官は基本的に「この学生はおそらく何か間違ったことをしたが、それがあなたを傷つけたことを証明していない」と言いました。

Anthropicの訴訟は、たくさんの本を読んで(合法的にまたは違法に)、その後オリジナルのエッセイを書いた学生のようなものでした。裁判官は「書き方を学ぶために本を読むことは、たとえ本にお金を払わなかったとしても問題ない」と言いました - しかし、学生が段落を直接コピーしていたら、それは別だと警告しました。

結論: Metaは悪い事実(お金を節約するために意図的に海賊版コンテンツを使用)で負けましたが、技術的な問題で勝ちました。Anthropicは「学習対コピー」についてのより実質的な議論で勝ちましたが、実際にコンテンツを直接コピーしていた場合に何が起こるかについての大きな警告がありました。

Metaは、原告が十分な損害を証明できなかったという技術的な理由で責任を免れましたが、裁判官は同社の訓練方法を強く非難し、ライセンス料の支払いを避けるために違法に入手したコンテンツを意図的に使用したことを批判しました。

一方、Anthropicは、コンテンツの使用が変換的であるという考えに基づいて訴訟に勝ちました。しかし、裁判官は、原告がAIが正確なコピーや代替品を作成していることを証明できれば、この議論は失敗するだろうと警告しました。これらの訴訟は、AIがどのように訓練されるかについての法的な問題を解決していません。代わりに、業界の現在の慣行に疑問を投げかけるために使用できる具体的な議論を強調しています。これにより、世界中で係争中の約50件の他の訴訟により明確な方向性が与えられます。

私は訴訟の法的なメリットについて議論するつもりはありませんが、これがAIを使って仕事をする私たちにどのような影響を与えるかに焦点を当てたいと思います。

これらの判決が私たちに示す主なことは3つあると思います

- LLMを開発する企業は、優位性を得るためにモデルをどのように訓練するかを慎重に考える必要がある。

- 大規模モデルはもはやそれほど重要ではなくなり、私たちが所有するデータを使用して訓練された、より小さく専門的なモデルを使用する方が良いかもしれない。

- LLMで著作権所有者の作品を使用したい場合、彼らの作品に対してどのように補償するかを本当に考える必要がある。

日本の第30条の4

では、日本を見てみましょう。ここには、2018年に改正された「著作権法 第30条の4」があります:

第30条の4(著作物に表現された思想又は感情の享受を目的としない利用) 著作物に表現された思想又は感情を自ら享受し又は他人に享受させることを目的としない場合には、その必要と認められる限度において、いずれの方法によるかを問わず、当該著作物の利用をすることができる。 ただし、当該著作物の種類及び用途並びにその利用の態様に照らして著作権者の利益を不当に害することとなると認められる場合には、当該著作物の利用をすることができない。

心に留めておくべき重要なことが2つあります:

- 著作権で保護された素材を単に楽しみのために使用しているかどうか。

- 素材を作成した人に属する権利を不当に利用すること。

私の理解では、日本の法律は素材をどのように入手したかについて区別しません。米国にあるような「フェアユース」の概念はありません。

基本的に、著作権で保護された素材を自分の楽しみのため(本を読んだり映画を見たりするような)ではなくAIを教えるために使用し、あなたの実験や研究が創作者の権利と収入を脅かさない(例えば、彼らの作品の価値を下げるような非常に似たものを作成することによって)限り、そしてそれが絶対に必要である限り、おそらく進めることが許可されています。

もちろん、それほど単純ではありません。出版社との契約や素材に関連するその他の法的約束は依然として適用されます。第30条の4が訓練データをどのように見つけたかについて何も言っていないからといって、図書館から著作権のある本を単に持ち去ることはできません。それは窃盗であり犯罪です。

出典:改正著作権法 第30条の4解説:AI・ビッグデータ時代の著作権法

まとめ

日本の第30条の4を考慮すると、日本でAIモデルを訓練することで、必要なデータを取得しやすくなる可能性があります。この法律は、研究と分析のために使用され、著作権所有者の権利を不当に害しない限り、著作権のある素材での訓練を許可しています。

しかし、より小さく専門的なAIモデルを使用し、創作者に支払う方法を見つけることについての私の以前のポイントは依然として重要です。研究によると、AIモデルから見られる改善は、モデルが大きくなるにつれて小さくなることが多いことが示されています。これは、非常に大規模なAIモデルで達成できることには限界があることを示唆しています。

最後に、創作者に支払うことなく著作権のある素材を使用してAIを訓練することが法的にできるかどうかにかかわらず、私たちは彼らに補償する方法を見つけるべきだと思います。私たちのAIが人々が新しい作品を創作することの魅力を減らすことは望ましくありません。機械は人間がすでに作ったものをコピーすることしかできません。彼らは本当に新しいものを想像したり発明したりすることはできません:機械は模倣することしかできず、「創造」するものを本当に理解することはできません。